2 月 10 日,阿里巴巴達摩院發布具身智能大腦基礎模型 RynnBrain,并一次性開源了包括 30B MoE 在內的 7 個全系列模型。RynnBrain 首次讓機器人擁有了時空記憶和空間推理能力,智能水平實現大幅躍升,在 16 項具身開源評測榜單上刷新紀錄(SOTA),超越谷歌 Gemini Robotics ER 1.5 等行業頂尖模型。

2 月 10 日,阿里巴巴達摩院發布具身智能大腦基礎模型 RynnBrain,并一次性開源了包括 30B MoE 在內的 7 個全系列模型。RynnBrain 首次讓機器人擁有了時空記憶和空間推理能力,智能水平實現大幅躍升,在 16 項具身開源評測榜單上刷新紀錄(SOTA),超越谷歌 Gemini Robotics ER 1.5 等行業頂尖模型。

據介紹,具身模型的智能水平已成為行業發展的重要瓶頸,尤其是泛化能力亟待提升。業界形成了多條技術路線的探索:一類是動作模型,從機器人末端動作輸出著手,發展出可以直接操作物理世界的 VLA 模型,但 VLA 模型往往因為數據稀缺難以實現泛化;另一類是大腦模型,從本身具有泛化能力的 VLM 等模型入手,但他們普遍缺乏記憶能力,動態認知受限,且普遍存在物理幻覺,難以支持人形機器人復雜的移動操作。

為了克服這些問題,達摩院的 RynnBrain 模型創造性地引入了時空記憶和物理世界推理,這是機器人與環境互動所需的兩項基本能力。時空記憶能力可讓機器人在其完整的歷史記憶中定位物體、目標區域,甚至預測運動軌跡,從而賦予機器人全局時空回溯能力。物理空間推理不同于傳統的純文本推理范式,RynnBrain 采用文本與空間定位交錯進行的推理策略,確保其推理過程緊密扎根于物理環境,大大減弱了幻覺問題。舉例來說,運行 RynnBrain 模型的機器人,在執行 A 任務中被突然打斷要求先做 B 任務,它能記住 A 任務的時間和空間狀態,等完成 B 后繼續工作。

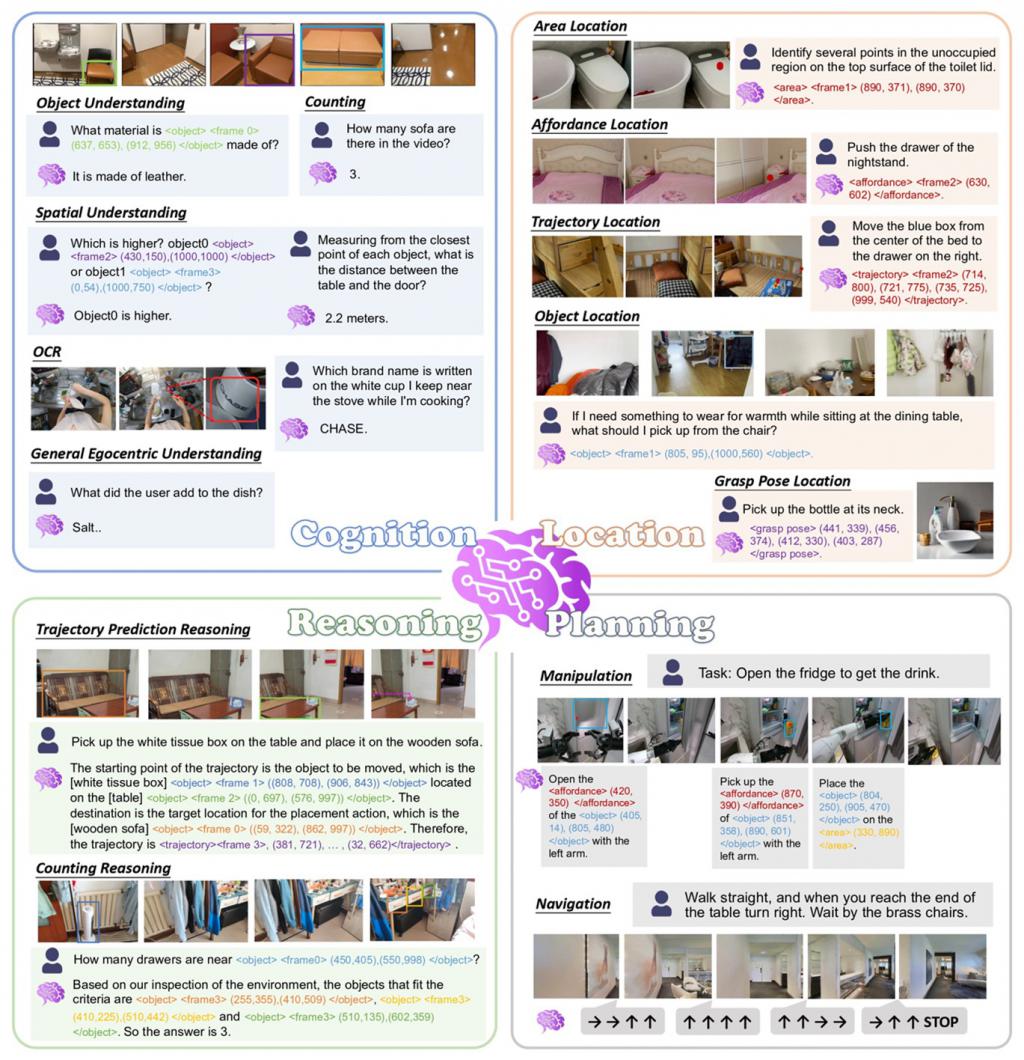

RynnBrain 具有認知、定位、推理、規劃等多重能力

RynnBrain 具有認知、定位、推理、規劃等多重能力

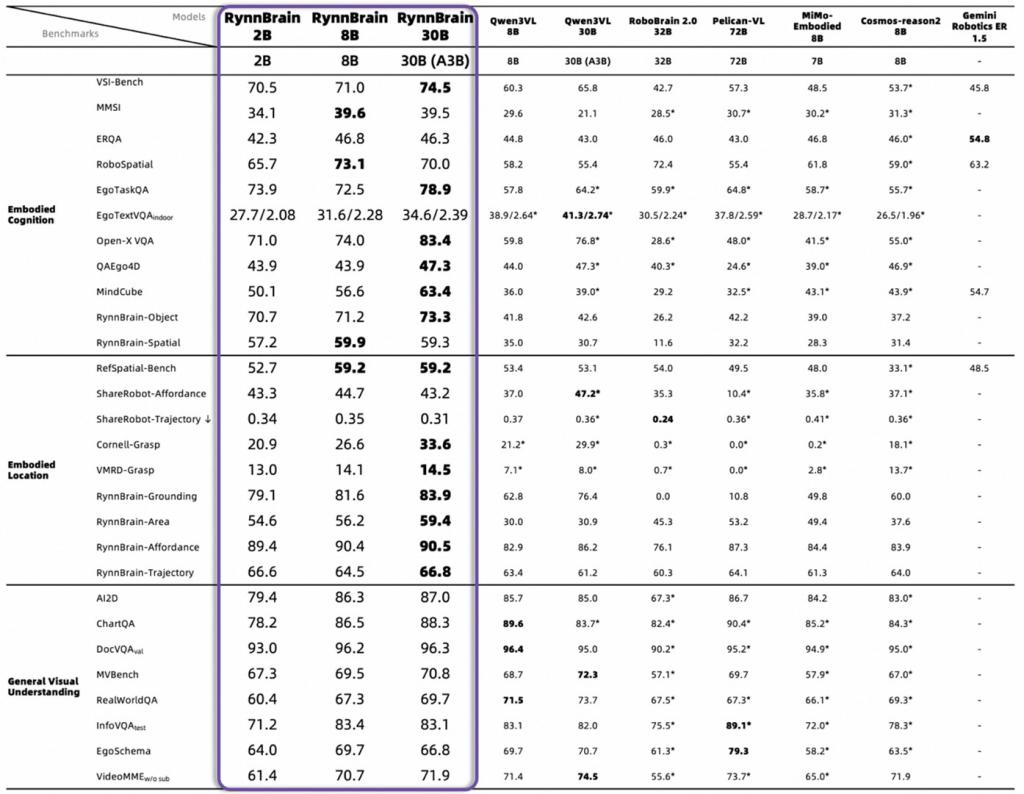

RynnBrain 在 Qwen3-VL 基礎上訓練,使用自研的 RynnScale 架構進行訓練優化,同等資源加速兩倍,訓練數據超過 2000 萬對。結果顯示,RynnBrain 能力全面,性能領先,在 16 項具身開源評測榜單上刷新紀錄(SOTA),包括環境感知與對象推理、第一人稱視覺問答、空間推理、軌跡預測等,超越了谷歌 Gemini Robotics ER 1.5、英偉達 Cosmos Reason 2 等具身頂尖模型。

RynnBrain 在 16 項具身評測上實現 SOTA

RynnBrain 在 16 項具身評測上實現 SOTA

RynnBrain 還擁有良好的可拓展性,能夠快速后訓練出導航、規劃、動作等多種具身模型,有望成為具身行業的基礎模型。以具身規劃模型為例,其需要強大預測能力和場景解析能力,但基于 RynnBrain 為基礎,只需幾百條數據微調,效果就能超越 Gemini 3 Pro,輕松實現 SOTA。

以開源完整的推理與訓練代碼的方式,達摩院此次開源了 RynnBrain 全系列模型,共計 7 個,包含全尺寸基礎模型與后訓練專有模型,其中有業界首個 MoE 架構的 30B 具身模型,只需要 3B 的推理激活參數就能超越業界的 72B 模型效果,因此能讓機器人動作更快、更絲滑。同時,達摩院還開源了全新評測基準 RynnBrain-Bench,用于評測時空細粒度具身任務,填補了行業空白。

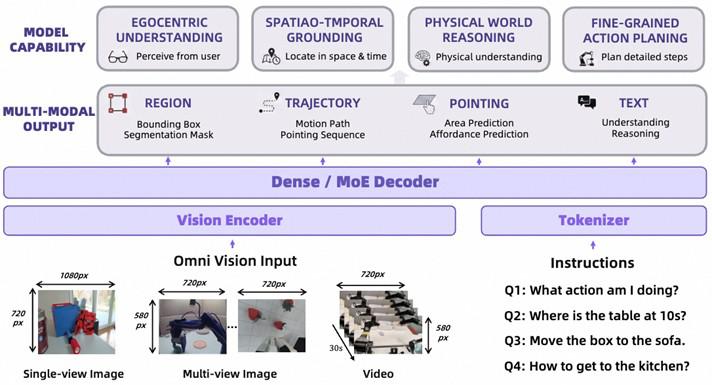

RynnBrain 模型架構

RynnBrain 模型架構

達摩院具身智能實驗室負責人趙德麗表示:"RynnBrain 首次實現了大腦對物理世界的深度理解與可靠規劃,為大小腦分層架構下的通用具身智能邁出關鍵一步。我們期待它加速 AI 從數字世界走向真實物理場景的落地進程。" 據了解,達摩院積極投入具身智能,正在構建可部署、可擴展、可進化的具身智能系統,已開源了融合世界模型和 VLA 模型的 WorldVLA、世界理解模型 RynnEC 等具身模型,以及業界首個機器人上下文協議 RynnRCP 。

來源:獵云網